痒いとこに手が届かないことをする、それがAI。

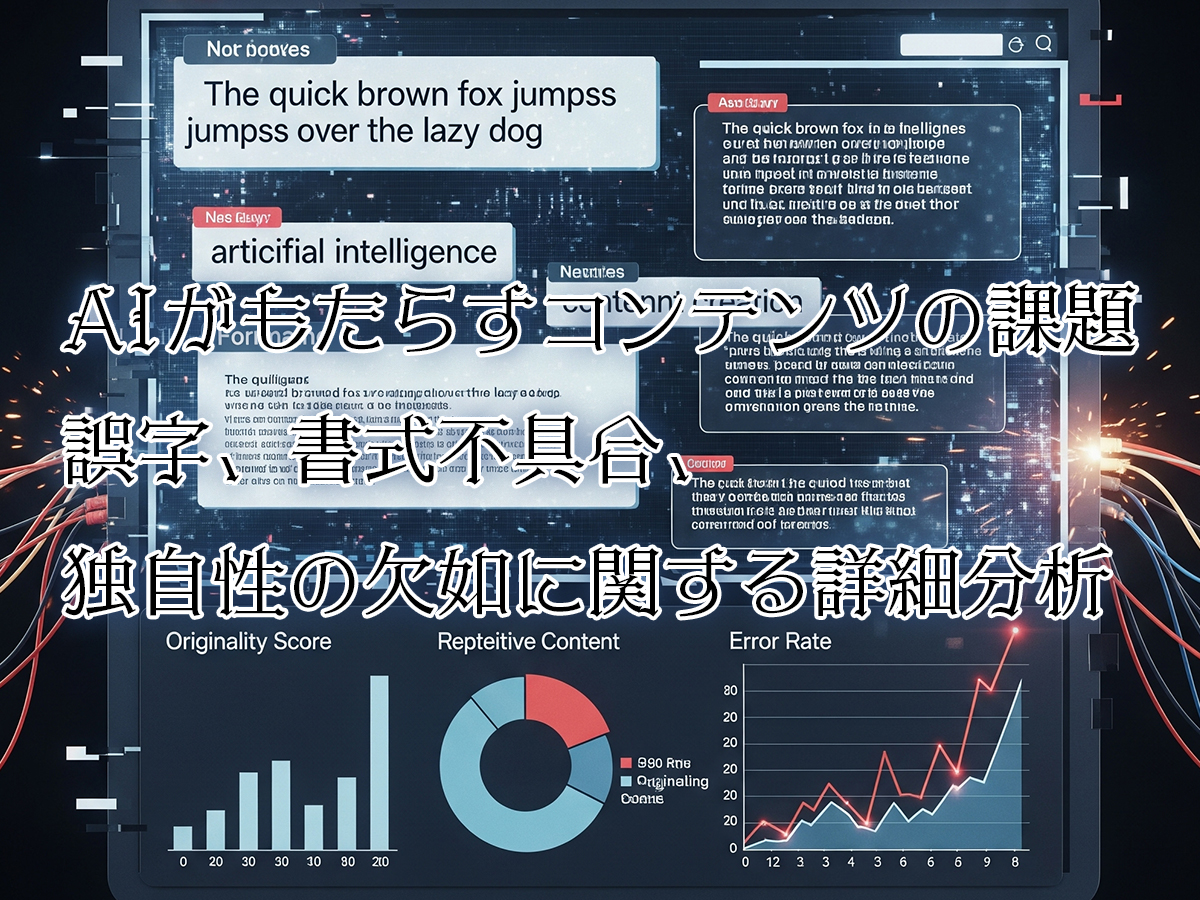

ChatGPTやGeminiに代表される大規模言語モデル(LLM)は、コンテンツ生成の在り方を根本から変革し、多くの産業に効率化と生産性向上をもたらしました。しかし、その技術的な成長と普及の裏側で、無視出来ない本質的な課題も顕在化しています。本レポートは、AI生成コンテンツが抱える主要な3つの問題、すなわち「信頼性の課題(誤字・ハルシネーション)」、「運用上の障壁(書式不具合)」、そして「創造性の限界(独自性の欠如)」について、その根本原因とビジネスへの影響を多角的に分析します。

調査の結果、これらの問題は単なる技術的なバグではなく、AIの構造的な特性に起因することが明らかになりました。AIは「事実のデータベース」ではなく、膨大なデータから言語のパターンを学習し、最も確率の高い出力を生成する「確率的推論エンジン」です。この本質的な性質が、誤った情報を生成するハルシネーションや、平均的で無難なコンテンツの均質化といった問題を引き起こします。また、AIが生成する非標準的な書式データと、既存のコンテンツ管理システム(CMS)との互換性の低さが、実務における新たな障壁となっています。

本レポートは、これらの課題を克服する為に、AIを「完璧な代替物」としてではなく、「人間の能力を増幅するツール」として再定義することを提言します。ハルシネーションのリスクを理解した上でのファクトチェックの義務化、Markdown形式を活用した効率的なワークフローの構築、そしてAIには代替出来ない人間の能力(創造性、共感性、倫理観)に投資する戦略こそが、AI時代を生き抜くための鍵となります。AIと人間がそれぞれの強みを活かし、協調する「Human-in-the-Loop」モデルを確立することが、持続的な競争優位性を築く上で不可欠であると結論付けます。

第1章: 序論 — AI時代のコンテンツ品質管理

1.1 AI革命の光と影

生成AIの急速な普及は、コンテンツ制作の風景を一変させました。ChatGPTやGeminiのようなLLMは、文章作成、要約、翻訳、アイデア出しといったタスクを瞬時に実行する能力により、個人から企業まで幅広いユーザーの生産性を飛躍的に向上させました。これにより、これまで専門家や熟練した担当者にしか出来なかった作業が、誰にとっても身近なものになりつつあります。この効率化の側面は、コンテンツマーケティング、カスタマーサポート、研究開発等、多岐にわたる分野でイノベーションを加速させています。

しかし、このAI革命の「光」の側面が強調される一方で、見過ごされがちな「影」の側面も存在します。生成AIが作り出すコンテンツは、時に誤った事実を含み、意図しない体裁の崩れを引き起こし、また、画一的で独自性に欠ける傾向が指摘されています。これらの問題は、AIの導入を検討している企業や、既に活用しているクリエイターにとって、無視出来ない重大な課題となっています。本レポートは、これらの課題が何故発生するのか、そしてそれらがどのような影響を及ぼすのかを深く掘り下げ、今後の戦略立案に資する知見を提供することを目的とします。

1.2 調査の目的とスコープ

本レポートの目的は、AI生成コンテンツの品質に関する具体的な3つの課題、すなわち「誤字・ハルシネーション」、「フォーマットの不具合」、そして「独自性の欠如」を、ChatGPTとGeminiを中心に調査・分析することです。単に現象を列挙するのではなく、その背景にある技術的・構造的要因を解明し、問題の本質を明らかにします。具体的には、LLMが情報を処理するメカニズム、日本語の特性が品質に与える影響、そしてAIの進化が人間の創造性や仕事の価値観にどのような変化をもたらしているかを考察します。

この分析を通じて、ユーザーがAIを賢く使いこなす為の実践的なヒントと、企業がAIを戦略的に導入するための指針を提示します。最終的に、AIが単なる道具ではなく、人間の能力を補完し、新たな価値を創造するパートナーとして共存する未来に向けた展望を提示します。

第2章: テキスト生成の信頼性課題 — 誤字とハルシネーション

2.1 ハルシネーション(幻覚)問題の深層分析

AIが生成する最も深刻な問題の一つに、ハルシネーション(幻覚)があります。これは、AIが事実に基づかない、または完全に虚偽の情報を、あたかも真実であるかのように自信をもって生成する現象を指します。多くのユーザーはAIを「正確な知識の源泉」として期待しがちですが、この現象はAIの根本的な動作原理を理解することで初めてその危険性を把握できます。

AIは、人間のように意味を理解しているわけではありません。その核心にあるのは、膨大な学習データから単語やフレーズの出現パターンを統計的に学習し、「次に来る単語」を確率的に予測して生成するモデルです。ハルシネーションは、この確率的推論の過程で、現実から乖離した出力を生成することで発生します。これは、人間の脳が雲の形から顔を認識するのと似た、パターン認識の誤りであると比喩的に説明されます。

ハルシネーションが発生する主な原因としては、以下のような要因が挙げられます。

・不正確または偏ったトレーニングデータ:

インターネット上には、事実と異なる情報や、更新されていない古いデータ、偏った情報が多数存在し、AIがこれらを学習してしまうことが原因となります。

・過学習(Overfitting):

モデルが特定のトレーニングデータに過剰に適合し、新しい入力に対して柔軟に対応出来なくなり、特定のフレーズを繰り返したり、誤った出力を生成したりしやすくなります。

・アーキテクチャの欠陥:

モデルの複雑さや処理能力が不十分な場合、言語の文脈や文化的なニュアンスを正しく理解出来ず、的外れな回答を生む原因となります。

具体的なハルシネーションの事例として、Googleのチャットボット「Bard」(現Gemini)が、ジェイムズ・ウェッブ宇宙望遠鏡に関する誤った情報を生成したことが報じられています。また、法律分野においては、AIがもっともらしいが架空の判例を引用したことで、実際に弁護士が訴訟で問題になった事例も存在します。これらの事例は、AIの回答をファクトチェックなしに「完璧な最終成果物」として利用するリスクが、専門性の高い分野では特に重大であることを示しています。したがって、AIは「万能な知識のデータベース」ではなく、あくまで「下書きや草案」として位置付け、人間の最終的なレビューとファクトチェックを必須とするワークフローを構築することが不可欠です。

2.2 日本語固有の誤字・脱字問題

ハルシネーションに加えて、AIは誤字や脱字、不自然な表現といった、より微細な品質の問題も抱えています。この問題は、特に日本語の特性によって複雑化します。

英語のLLMがベースとなっている場合が多い中で、日本語には固有の言語的・構造的課題が存在します。

・トークン化の難しさ:

英語は単語がスペースで区切られていますが(分かち書き)、日本語は連続した文字列で構成されます。この為、言語モデルが文章を最小単位である「トークン」に分割する際に、単語の区切りを正確に判断することが困難になります。

・複雑な文字体系と文法:

日本語は、漢字、ひらがな、カタカナの3つの文字体系を持ち、特に数千種類に及ぶ漢字は、読み方や意味が多様です。また、日本語の文法構造は主語-目的語-動詞(SOV)の順序であり、文の意味を決定する助詞が重要な役割を果たす等、主語-動詞-目的語(SVO)の英語とは根本的に異なります。

これらの課題は、AIが日本語の文章を生成する際に、不自然な句読点や表記のゆらぎ、不適切な漢字変換を引き起こす原因となります。また、長い文章の生成を指示した場合に、途中で回答が途切れてしまうといった技術的な制約も報告されています。このような日本語の構造的な複雑性は、AIのハルシネーションや誤字のリスクをさらに高める結果を招きます。したがって、日本語のコンテンツを扱う際には、英語以上にきめ細やかな人間のレビューと校正が求められることになります。AIの導入効果を最大化する為には、ツールの選定だけでなく、言語の特性に合わせたワークフローの最適化が不可欠です。プロンプトを具体的かつ明確にし、複雑な質問を分解して対話を進めるといった工夫が、出力精度の向上に特に効果的です。

2.3 ChatGPTとGeminiの精度比較

AIモデルの選択は、コンテンツの品質に直接影響を与えます。ChatGPTとGeminiは、それぞれ異なる特性を持つ為、どちらか一方が「優れている」と結論付けるのではなく、タスクの性質に応じて使い分けることが重要です。

ハルシネーション発生率に関する複数の評価では、Gemini 2.5 Flashが低いハルシネーション率で高く評価されているという報告があります。一方で、特定の試験データではChatGPTが全モデル中トップの成績を収めているという結果も存在し、評価基準によって結果が変動することが示唆されています。回答の質についても、ChatGPTの精度を高く評価する声がある一方、Geminiの回答も十分な水準にあるとされています。

無料版と有料版の性能差も無視出来ません。無料版のChatGPTは主にGPT-3.5モデルを使用しており、有料版(Plus)で利用出来る最新のGPT-4oモデルに比べて、機能や利用回数に厳しい制限があります。特に、一度に出力できる文字数が限られている為、長文の校正には適さない場合があります。これらの制限は、コンテンツ制作の効率に直接的な影響を及ぼします。

各モデルの得意分野を理解することは、賢明なツール選定の鍵となります。

・Gemini:

計算や数式処理、データ分析、簡潔な要約に長けています。

・ChatGPT:

より人間らしい、自然で高度な文章作成、複雑なテキストの生成に向いています。

したがって、「万能なAI」は存在しません。企業のコンテンツ戦略担当者やクリエイターは、タスクの性質(データ分析か、創造的な文章作成か)に応じて最適なモデルを選択することで、品質と効率を両立させることが出来ます。

以下に、主要AIモデルの性能比較をまとめた表を提示します。

表2-1. 主要AIモデル(ChatGPT vs. Gemini)性能比較表

| 項目 | ChatGPT | Gemini |

| ハルシネーション発生率 | 複数の評価でトップクラスとされるが、Geminiより高いという報告も。 | 複数の評価で最も低いと評価されるが、ゼロではない。 |

| 誤字・脱字の傾向 | 高度な日本語生成に優れる一方、表記揺れや文法の不自然さが残ることがある。 | 簡潔な出力に優れるが、直訳調の不自然な表現が見られることもある。 |

| 日本語の自然さ | 人間らしい自然な文章生成が得意。 | 簡潔で実用的な出力が特徴。直訳調になる場合もある。 |

| 得意分野 | 複雑な文章作成、対話、思考プロセスの説明。 | 数式処理、データ分析、簡潔な要約。 |

| 無料版の制限 | 厳格な文字数・利用回数制限。最新モデル(GPT-4o)の利用は限定的。 | 無料で最新モデル(Gemini 1.5 Pro等)が利用可能な場合がある。 |

第3章: 運用上の障壁 — フォーマットの不具合とその技術的背景

3.1 コピー&ペーストによる書式崩れのメカニズム

AIが生成したテキストをWordpress等のコンテンツ管理システム(CMS)に貼り付ける際、意図しない書式崩れが発生することは、コンテンツ実務担当者が直面する一般的な問題です。箇条書きの記号が混在したり、太字や斜体の装飾が失われたりする現象は、単なる手間の問題ではなく、AI生成ワークフローにおける見えないボトルネックとなり得ます。 (※絶妙に手間暇がかかる)

この問題の技術的な背景は、主に以下の2点に起因します。

・非標準的な書式データの混入:

AIが生成するテキストには、目に見えない余分なHTMLタグやCSSプロパティ等の書式データが含まれることがあります。これらのデータは、AIが学習した様々なWebページから抽出された不統一な書式体系に由来する可能性があります。

・異なるソフトウェア間の不整合:

この問題はAIに特有のものではなく、元来、WordやExcelといったオフィスソフトからWeb文書に直接テキストを貼り付ける際にも頻繁に発生します。これは、オフィス文書とWeb文書が異なる「書式フォーマット」を持つ為です。例えば、WordPressの「書式設定をクリア」ボタンは、<strong>や<em>等のタグやフォント設定の一部を削除しますが、全ての書式を完全に消去出来るわけではありません。

・CMSの自動体裁機能との競合:

WordPressのGutenbergのようなブロックエディタには、自動的に段落タグ(<p>)や改行タグ(<br>)を挿入する機能が備わっています。AI生成テキストに含まれる非標準的な書式データが、この自動体裁機能と競合し、予期せぬレイアウト崩れを引き起こすことがあります。

AIはテキスト生成の時間を大幅に短縮しますが、その後に発生する書式修正の作業が新たな負担となり、全体の生産性向上を阻害する可能性があります。AIをワークフローに組み込む際には、この「隠れたコスト」を事前に評価し、対処法を確立しておくことが重要です。

3.2 Markdown: 究極の解決策か、新たな課題か

書式崩れの問題に対する最も効果的な解決策の一つは、AIに「Markdown形式で出力するように」と明確に指示することです。Markdownはシンプルで軽量なマークアップ言語であり、

“**テキスト**"で太字、- リストで箇条書きといった基本的な書式をテキストベースで表現出来ます。この形式で出力されたテキストは、多くのCMSや外部ツールで容易にHTMLに変換出来る為、書式の一貫性を保つ上で極めて有効です。

しかし、Markdownも万能ではありません。AIは完璧なMarkdownを生成するとは限らず、箇条書きの記号が混在するといった不統一な出力が残る場合もあります。また、WordPressのような環境では、既存のプラグインやテーマとの互換性問題が発生する可能性も考慮する必要があります。

実務においては、以下のような具体的な解決策を組み合わせることが推奨されます。

・AIへのプロンプト指示:

「Markdown形式で出力してください」と明確に指示することで、書式崩れのリスクを大幅に減らせます。

・専用ツールの活用:

MarkdownからHTMLへの変換に特化した外部ツールやウェブサービスを利用することで、クリーンなHTMLコードを生成し、CMSへの貼り付けを円滑にします。

・CMSの機能利用:

コピー&ペースト後にCMSの「書式設定をクリア」ボタンを使用し、不必要なタグを削除することも有効です。

これらの対処法は、AI生成テキストを中間形式で扱い、人間が最終的な整形と確認を行うという、AIと人間が協調する新しいワークフローの設計を促します。書式崩れの問題は、単なる技術的な課題ではなく、コンテンツ作成ワークフロー全体を再設計する機会と捉えるべきです。

以下に、AI生成テキストにおける書式不具合の原因と対策をまとめたマトリックスを提示します。

表3-1. AI生成テキストにおける書式不具合の原因と対策マトリックス

| 問題の種類 | 技術的背景 | 具体的な解決策 | |

| 箇条書きの記号が混在 | AIが学習した環境間の記号体系の違いによる不統一。 | ・プロンプトで「Markdown形式で箇条書き」と明確に指示する。 | ・「書式設定をクリア」ボタンでリセット後、手動で修正する。 |

| 太字・斜体が反映されない | Markdownの**や*記号が、貼り付け先で解釈されない。 | ・AIに「Markdown形式で出力」を指示し、変換ツールを経由する。 | ・CMSの「太字」ボタンを再度適用する。 |

| 余分な行間やスペースが入る | 隠れたHTMLタグやCSSデータ、CMSの自動体裁機能との競合。 | ・貼り付け先のCMSエディタで「テキストモード」に切り替えて貼り付ける。 | ・「書式設定をクリア」ボタンで不要な情報を削除する。 |

| 文章が途中で途切れる | AIの利用制限(文字数・トークン数)やサーバー負荷。 | ・有料プランへの移行を検討する。 ・プロンプトを分割して段階的に生成させる。 |

第4章: 創造性の未来 — 独自性の欠如と人間の役割の再評価

4.1 AI生成コンテンツの「均質化」現象

AIは、膨大な学習データに基づいて「平均的で最も確率の高い」出力を生成する傾向があります。このプロセスは、技術的な完成度を高める一方で、個々のアーティストが持つ「こだわり」や「世界観」 、そして人間の「創造性」の本質である「直感的で予測不可能な」組み合わせを再現することが困難です。この結果、AIが生成するコンテンツは、しばしば「無難に上手いが、驚きや個性がない」という印象を与え、市場全体のコンテンツの均質化を招く可能性があります。

・画像生成AI:

AIアートは技術的に非常に優れている一方で、見た目が似通った「見慣れた、無難な」絵が多くなり、「唯一無二」の価値が薄れてしまうという指摘があります。これは、アートの多様性を損ない、クリエイティブ市場が過剰供給に陥るリスクを伴います。

・ASMRコンテンツ:

AIは、現実では録音出来ないような幻想的な環境音や、SF的な音を生成することが出来ます。しかし、AI生成の音源には意図しない不快音(金属音、摩擦音等)が混入するリスクがあり、ASMRの本質である「聴き心地の良さ」を損なう可能性があります。また、手作業の温かみや、作り手の「気持ちがこもっている」という価値は、AIでは再現が難しいとされています。

AIは「良い」作品を効率的に大量生産出来る一方で、真に心を動かす「傑作」を生み出すことは困難です。これは、傑作には作り手の感情や物語、そして不完全さが不可欠であり、これらがコンテンツに深みと独自性をもたらす為です。コンテンツを量産する戦略から、ブランドの独自性を追求する戦略へとシフトする必要があることを示唆しています。

4.2 クリエイターからの視点 — 創作意欲と独自性のジレンマ

AIの台頭は、クリエイターコミュニティに賛否両論を巻き起こしています。ある調査では、イラストレーターの約7割が画像生成AIの商用利用に賛成しており、「多様な表現を可能にするから」という理由が最も多く挙げられました。AIを、自身の創作活動を加速させる為の新しい道具として前向きに捉える声も多数存在します。一方で、「創作活動への影響や著作権侵害への懸念」から反対する意見も同程度に存在しています。

興味深いことに、生成AIは人間の創造性に与える影響について、ある研究が示唆的な結論を出しています。AIは、元々創造性の低い人々の作品の質を向上させる一方で、元々創造性の高い人にはほとんど影響がないという結果が得られました。これは、AIが「創造的な出発点」を提供することで、誰もが一定レベルのコンテンツを作れるようになる「創造性の底上げ」に貢献する一方で、真のイノベーションや傑作は依然として人間から生まれることを示唆しています。

AIは創作の敷居を下げ、「クリエイティブな労働力」を飛躍的に増加させる一方で、市場には「無難に上手い」コンテンツが過剰に供給されるリスクを伴います。これにより、単価の低下や、真に才能あるクリエイターが埋もれてしまう可能性が指摘されます。

4.3 AI時代における人間の価値の再定義

AIによる効率化と均質化が進むにつれて、手間暇をかけるアナログ的な価値が再評価される傾向が強まっています。レコードやカセットテープ、フィルムカメラ、手書きの手帳といったアナログ製品が、若者層を中心に人気を博している現象は、デジタルでは得られない「手にとって五感で楽しむ体験」や「所有する喜び」に人々が価値を見出している証拠です。この「アナログ回帰」トレンドは、効率の対極にある「手間をかけること」や「気持ちを込めること」の価値が、よりいっそう輝き始めていることを示唆しています。

この潮流は、AIには代替出来ない人間の能力を再認識させる重要な機会を提供しています。

・共感性と感情:

AIは感情を理解することも、深く共感することも出来ません。人間同士の複雑で深い感情のやりとりや、共感に基づく創造性は、人間の独占的な強みです。

・自由意志と倫理観:

AIは学習データに基づいて予測可能な出力をしますが、人間の行動は予測不可能な直感や自由意志に導かれることがあります。AIが苦手とする倫理的な判断力も、人間がAIと共存する上で不可欠な要素です。

AIの台頭は、人間の存在意義を再考する触媒としての役割を担っています。AIが「効率」と「平均」を追求するなら、人間は「感性」と「独自性」を磨くことで、AIとの共存関係を築くことが出来ます。AI時代における企業の成功は、いかに効率化するかだけでなく、いかに人間の創造性や感性を活かしたコンテンツを創造出来るかにかかっていると言えるでしょう。

第5章: 結論 — 課題克服に向けた戦略的展望

5.1 主要課題の総括と相互関係

本レポートで分析した3つの主要な課題、すなわちハルシネーションを含むテキストの信頼性、コピペによる書式不具合、そしてコンテンツの均質化は、それぞれ独立した問題ではなく、密接に絡み合っています。AIの技術的限界(学習データへの依存や日本語処理の難しさ)は、ハルシネーションや誤字といった信頼性の問題を引き起こし、これが運用上の手間(書式修正の手間)を増大させます。そして、この「効率的なツール」が量産するコンテンツは、結果的に市場全体の均質化という創造性に関わるより高次な問題に繋がっています。

これらの問題は、AIを「完璧な答えを出す万能の機械」として扱うことの危険性を示しています。AIは、特定のタスクを効率的にこなすための強力なツールであり、その限界を正確に理解した上で、人間のレビューと判断を組み合わせる必要があります。

5.2 AIを最大限に活用する為の実践的提言

AIの力を最大限に引き出す為には、以下の3つの戦略的な提言が重要となります。

- AIの役割を明確に定義する:

AIを「優秀なリサーチャー」や「創造的な壁打ち相手」として活用することが賢明です。初稿作成、アイデア出し、データ分析といった得意なタスクに限定して利用することで、AIの強みを活かし、ハルシネーションや誤字のリスクを管理出来ます。 - 「Human-in-the-Loop」ワークフローの確立:

AIの出力を鵜呑みにせず、必ず人間のファクトチェック、校正、そして最終的な表現の調整を行うプロセスを組織的に組み込むべきです。これにより、AIが提供する効率性と、人間がもたらす信頼性と独自性の両方を確保出来ます。 - アナログ的価値の再評価と育成:

AIには代替出来ない「ストーリーテリング」、「共感性」、そして「独自の視点」といった人間固有のスキルを磨くことに投資することが、企業の長期的な競争力となります。AIが効率化の土台を築く一方で、人間はそこに唯一無二の価値を乗せる役割を担うべきです。

5.3 未来への展望: AIと人間の協調

AIは、人間を代替する脅威ではなく、むしろ人間が何に価値を見出すべきかを再認識させる触媒としての役割を担っています。AIが効率的な土台を築き、人間がその上に独自の創造性や感性を乗せる。この協調関係こそが、AI時代を生き抜く為の最も賢明な戦略です。

AIは、これまで膨大な時間と労力を要した定型的な作業を担うことで、人間がより高次の、創造的で、感情的な作業に集中する時間を生み出します。この新しい役割分担を通じて、私たちは単なる効率化を超え、より豊かで、より人間らしい社会を築いていくことが出来るでしょう。AIの真価は、人間の創造的なパートナーとなることで、初めて完全に発揮されるのです。

ChatGPTが作る人物画像はクォリティが良いけどChatGPTが作る絵柄がどこもかしこも使うからそろそろ「飽き」が来ますよね。

便利になっていく時代に何を失っていくのかよくよく考えて生きていきましょう。

.

.

.