AI規制・倫理・法政策分析レポート 2025

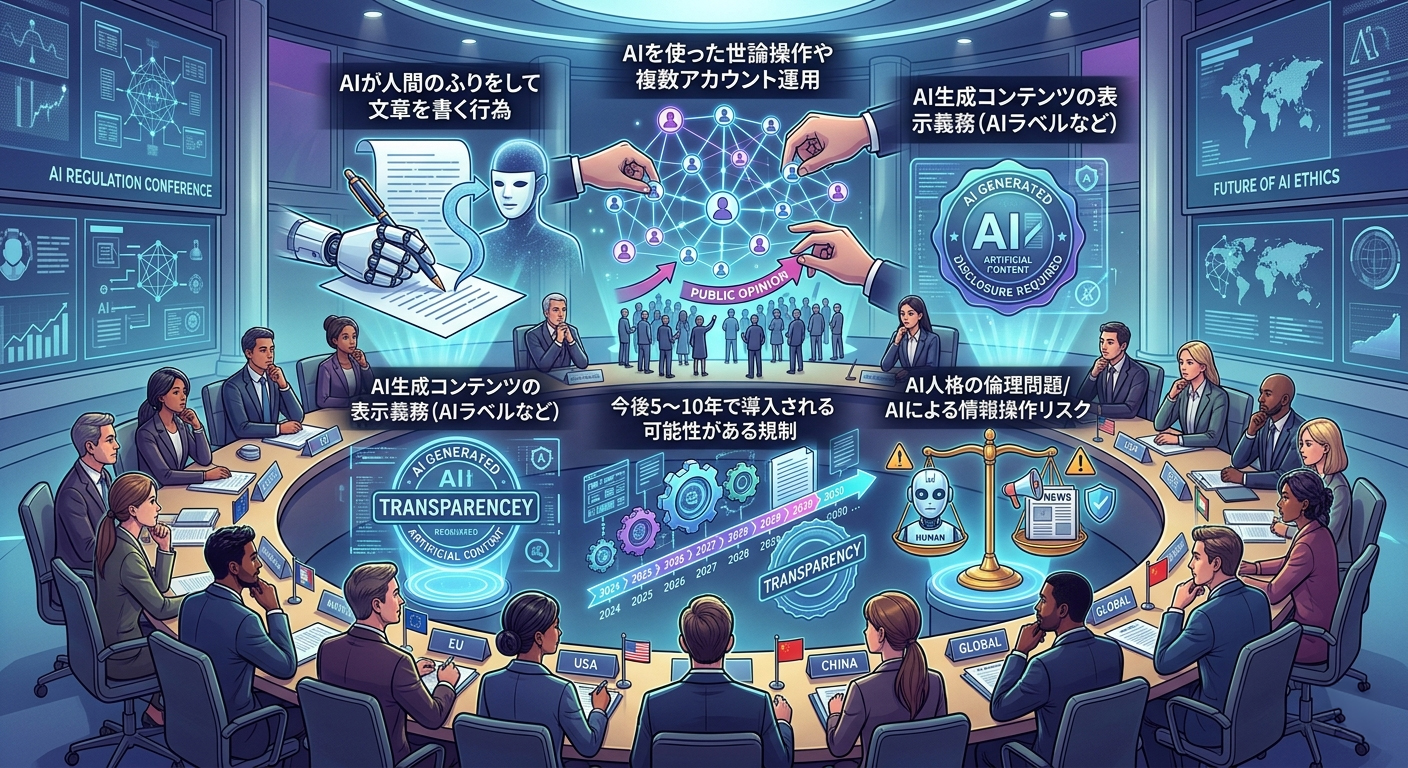

AIによる人格模倣・ゴーストライティング・情報操作

世界的規制動向と政策倫理的分析

EU AI Act / 中国深層合成規定 / 米国NO FAKES Act / 広島AIプロセス — 人間とAIの境界を巡る国際的闘争

AIが特定個人の文体・声・容姿を模倣し、「影の書き手」として機能する時代が到来した。デジタルツインの所有権は誰に帰属するのか。故人の人格をAIで「復活」させることは許されるのか。世界の規制当局が走り続ける理由を、六つの一次資料から解読する。

人工知能(AI)が生成する文章は、単なる情報の要約や翻訳の域を超え、特定の個人の文体や思考プロセスを模倣する「人格模倣」の段階に達している。この技術的進展は、AIが人間のふりをして意思疎通を行う「AIゴーストライティング」や、偽りの人格を用いた「世論操作」といった深刻な倫理的・法的課題を浮き彫りにしている。

2025年の研究によれば、インターネット上のコンテンツの過半数がAI生成物へと移行しており、スタンフォード大学の2025年AI Indexによれば、生成AIへの世界の民間投資は2024年に339億ドルに達し、2022年比で8.5倍超に膨らんでいる。この急拡大が、「認知の萎縮(cognitive atrophy)」や批判的思考能力の低下、そして民主主義的対話の不全を招くリスクが指摘されている。

Report Thesis — 本レポートの中心命題

AI人格模倣・ゴーストライティング・情報操作の三つの課題は、技術的問題ではなく人間の主体性に関わる根本問題である。EU・中国・米国・日本が走らせる規制の競争は、「誰が情報空間の信憑性を守るのか」という問いへの政治的回答である。

Chapter 01 — Ethics

AIによる人間模倣の倫理的論点——欺瞞・サイバー擬似作・認知の萎縮

1.1 欺瞞の問題とサイバー擬似作

AIが自らを人間であると偽ってコミュニケーションを行う場合、それは個人の自律性を侵害し、社会的信頼を損なう行為とみなされる。教育や研究の場では、AIを利用した不正行為が「従来の盗用」とは異なる新しい形態として現れている。これを「サイバー擬似作(cyber pseudepigraphy)」と呼び、自らの思考を経ずにAIにコンテンツを生成させながら、それを自らの知的能力の結果として提示する行為は、教育の本質を損なうものと批判されている。

従来の盗用は他者の著作物を流用するものであったが、AIによる生成は「誰も書いていないが、自分も書いていない」文章を生み出し、著作者の概念そのものを空洞化させる。

1.2 デジタルツインの法的地位と権利問題

ペンシルバニア大学の法学教授ジェニファー・ロスマン氏は、「知的財産法が人々を財産の一形態へと変換する方法」の専門家として、デジタルレプリカ時代の到来に強い警戒を示している。AIが特定の個人の姿、声、性格を完全に再現する「ヒューマン・デジタルツイン(HDT)」の技術は、その法的地位をめぐる複雑な議論を呼んでいる。

The Pennsylvania Gazette — Feature Article (Dec 2025)

Who Will Own Your Digital Twin?

thepenngazette.com/who-will-own-your-digital-twin/

もし個人の声や容姿の権利が企業に永続的に譲渡可能となれば、本人の意図しない文脈(成人向けコンテンツや政治的プロパガンダ)でその人格が利用され続けるリスクがある。

Chapter 02 — Disinformation

AI生成ディープフェイクと世論操作——FIMIの地政学的脅威

EUの欧州議会調査局(EPRS)が2025年12月に発表した報告書は、生成AIが外国による情報操作と干渉(FIMI)を劇的に加速させていると警告している。ロシアによるウクライナ侵攻以降、AI生成コンテンツを駆使した親ロシア的偽情報キャンペーンが急増しており、2022年3月にはゼレンスキー大統領が降伏を命じるよう見せかけたディープフェイク動画がTwitter・Facebook・YouTubeに拡散した。

EPRS Briefing — European Parliament (Dec 2025)

Information Manipulation in the Age of Generative Artificial Intelligence

europarl.europa.eu/RegData/etudes/BRIE/2025/779259/EPRS_BRI(2025)779259_EN.pdf

Frontiers in Artificial Intelligence — Peer-Reviewed (2025)

AI-Driven Disinformation: Policy Recommendations for Democratic Resilience

frontiersin.org/journals/artificial-intelligence/articles/10.3389/frai.2025.1569115/full

2.1 「作戦オーバーロード」と組織的偽装工作

2025年1月〜3月、ISD(戦略対話研究所)はロシア系の作戦「Operation Overload」が80以上の組織を模倣していたことを確認した。Wall Street Journal のロゴを用いた偽動画はUSAIDが「ウクライナの子供たちにLGBTQ+の価値観を資金提供した」と虚偽主張する等、メディアの信頼性そのものを武器とする手法が確認されている。

Chapter 03 — Global Regulation

AI生成コンテンツの透明性義務——EU・中国・米国の規制比較

3.1 EU AI Act 第50条:透明性義務の重層的構造

EU AI Actは、AIシステムが人間と直接対話する場合、それがAIであることをユーザーに知らせることを義務付けている。ディープフェイクや公共の利益に関わる文章を生成するデプロイヤーは、その事実を明示しなければならない。GPAI(汎用AI)モデルのプロバイダーには、学習データの内容の要約を公開し、著作権法を遵守することが求められている。

EU AI Act — Key Issue 5

透明性義務(Transparency Obligations) — Chapter IV

euaiact.com/key-issue/5

3.2 中国:GB 45438-2025 ラベル表示措置

中国の「AI生成コンテンツのラベル表示措置(GB 45438-2025)」は2025年9月から施行されており、以下の厳格な義務を課している。

3.3 米国:州法の先進と連邦法の空白

米国では連邦レベルでの包括的AI法は未だ存在しない。しかしカリフォルニア州のB.O.T. Act(AB853)は100万人以上のユーザーを抱える生成AIシステムに対し、AIが生成したものであることの潜伏的・明示的開示を義務付けている。テキサス州のTRAIGAは自傷行為の扇動・不法な差別の助長・不法なディープフェイク生成を禁じる。

Anecdotes.ai — Regulatory Overview (2025)

AI Regulations in 2025: US, EU, UK, Japan, China & More

anecdotes.ai/learn/ai-regulations-in-2025-us-eu-uk-japan-china-and-more

3.4 三極規制の比較

| 比較項目 | EU AI Act | 中国 GB 45438-2025 | 米国 大統領令14110 |

|---|---|---|---|

| 基本理念 | 基本権の保護とリスク管理 | 社会的安定と国家安全保障 | イノベーション促進と安全確保 |

| テキスト生成の表示 | 公共の関心事に関する場合のみ義務 | すべてのAIテキストに明示的表示 | 連邦機関は必須、民間はガイドライン |

| メタデータの義務 | 機械判読可能な形式で必須 | サービスプロバイダー情報を含め必須 | NISTが基準を策定中 |

| 執行の主体 | AI Office および各国当局 | サイバー空間管理局(CAC) | 各省庁(強制的法的拘束力は限定的) |

Chapter 04 — Professional Ethics

専門職におけるAIゴーストライティング——法曹・ジャーナリズム・学術

AIが専門的な文章を「代筆」することの影響は、単なる効率化を超え、専門職の責任と信頼の構造を再編している。法曹界では、AIが生成した誤った判例を法廷に提出するリスクが現実化している。カリフォルニア州弁護士会のガイドライン(2023年)は、AIの出力をそのまま使用することを禁じ、弁護士が全ての内容を検証し、自身の名前で責任を持つことを求めている。

Law — 法曹界

人間による監視の義務

- AI出力のそのままの使用を禁止

- 弁護士が全内容を検証し自身の名で責任を持つ

- 秘密保持義務(ルール1.6):クライアント情報のAI入力に厳格なセキュリティ確認

- 誤った判例提出リスクが現実化

Journalism — ジャーナリズム

Human-in-the-loop の原則

- AP通信:AIによる記事の直接執筆を禁止。バックエンド業務(要約・メタデータ付与)のみに限定

- インドネシア新聞評議会2025年規制1号:正確性・公平性・独立性の厳格な編集管理を要求

- 最終的な執筆と判断を人間に限定

Chapter 05 — Postmortem Rights

デジタルツインと故人のAI人格——NO FAKES Actと死後の権利

AI技術が故人の「復活」を可能にする中、人間の人格をどこまで法的に保護すべきかという問題が議論されている。米国では、故人の肖像や声が無断で利用されることへの対策として、連邦レベルの「NO FAKES Act」が提案されている。この法案は、有名人だけでなく一般市民に対しても、自身のデジタル・レプリカを制御する権利を認めるものである。

WFU Journal of Law & Policy

Deepfakes of the Dead: Applying Postmortem Publicity Law to AI Digital Replicas

wfujournaloflawandpolicy.org/deepfakes-of-the-dead-…

Chapter 06 — Future Outlook

今後5〜10年の規制展望——自律型エージェントと広島AIプロセス

AI技術が「自律型エージェント(Agentic AI)」へと進化する2026〜2030年にかけて、規制の焦点は静的なコンテンツ生成から、動的な意思決定と行動へと移行する。AIエージェントが自律的にコードを実行し、契約に署名し、取引を完了させる未来に向けて、「代理人法(Agency Law)」の再解釈が進んでいる。

Scenario 1

予測不能な高度AI

高度な能力を持つオープンソースモデルが拡散し、事故や悪用による深刻な負の影響が生じるシナリオ(英国GO-Science 2030年予測)。AIリテラシーが組織ガバナンスの評価指標となる。

Scenario 2

労働市場の混乱

事務職から技能職まで広範な労働が自動化される。AIの出力を検証する「リテラシー」が単なるスキルの枠を超え、組織の競争力と倫理的ガバナンスの核心となる。

HAIP

広島AIプロセス

G7主導の国際行動規範。「HAIP報告フレームワーク」の本格運用により、国境を越えたAIの安全性評価と透明性向上が期待される。

技術的な透明性の確立

中国の厳格なラベル表示義務やNISTの標準化作業に見られるように、コンテンツの生成源を特定出来るデジタル署名やメタデータの埋め込みを、国際的なデファクトスタンダードとして定着させる。

法的責任の明確化

AIが自律的に行動する時代においては、事後的な「損害賠償」だけでなく、設計段階から法規範を遵守させる「法令遵守型AI(LFAI)」の導入や、AIエージェントの行動ログの保存を義務付けることで、事後の追跡可能性を確保しなければならない。

人間の主体性の再定義

専門職領域におけるAI利用の拡大は、人間にしか出来ない「批判的思考」や「倫理的判断」の価値を逆説的に高めている。情報の信憑性を守る最終的な防衛線は、依然として人間の誠実性と、情報を検証する社会的な仕組みの中に存在する。

AI人格と情報の信憑性を守る為に

AIによる人間模倣とゴーストライティングの進展は、情報の受け手に対して「常にAIの存在を疑う」という新たな認知の負担を強いている。欺瞞者となるか、良き補助者となるか——AIの未来は、現在進行中のこれらの規制と倫理的議論の帰結に委ねられている。

今後5年から10年にかけて、AIは私たちのコミュニケーションの不可欠なパートナーとなるだろう。その時、情報の信憑性を守る最終的な防衛線は、依然として人間の誠実性と、情報を検証する社会的な仕組みの中に存在する。

引用・参考資料

- EPRS, “Information manipulation in the age of generative artificial intelligence,” PE 779.259, Dec. 2025 — europarl.europa.eu

- Frontiers in Artificial Intelligence, “AI-driven disinformation: policy recommendations for democratic resilience,” 2025 — frontiersin.org

- WFU Journal of Law & Policy, “Deepfakes of the Dead: Applying Postmortem Publicity Law to AI Digital Replicas” — wfujournaloflawandpolicy.org

- The Pennsylvania Gazette, “Who Will Own Your Digital Twin?” Dec. 2025 — thepenngazette.com

- EU AI Act — Key Issue 5: Transparency Obligations — euaiact.com/key-issue/5

- Anecdotes.ai, “AI Regulations in 2025: US, EU, UK, Japan, China & More” — anecdotes.ai

- Stanford University, AI Index 2025(生成AI民間投資データ)

- Cornell University, LLM使用による認知萎縮研究(2025年)

- 中国 GB 45438-2025「AI生成コンテンツのラベル表示措置」(2025年9月施行)

- G7広島AIプロセス(HAIP)国際行動規範